Jako buzz-termin AI-agentów mówi się wszędzie. Z Moltbotem (Clawdbot) koneserowie tych agentów zostali ostatecznie popularni. Jednakże, aby działać skutecznie, AI-agenci potrzebują daleko idących uprawnień. To powoduje duży ryzyko związane z takimi samoczynnymi i nieprzeźrocznymi programami.

Wprowadzenie

E-maile z szablonowymi zapytaniami, które pojawiają się w Twojej skrzynce odbiorczej, są automatycznie odpowiadane, bez konieczności Twojego interweniowania. Wpisujesz zadanie badawcze do swojego Messengera Signal. Twój agent AI przejmuje zadanie, szuka potrzebnych informacji w wyszukiwarkach i tworzy odpowiedź, którą możesz przeczytać minutę później w Messengera lub otworzyć za pomocą linku na raport z niego.

Precyż to i jeszcze wiele więcej jest możliwe z AI-Agentami. Istnieje nawet otwarta źródłowa rozwiązanie, które to potrafi. Nazywa się Clawdbot (wcześniej Clawdbot) i w krótkim czasie stało się znane. Twórca Moltbota udało się coś, czego miliardowe koncerny Big Tech nie mogły dotąd osiągnąć.

Moltbot pozwala na podłączenie często używanych kanałów i usług, m.in.

- Messengerowanie: Signal, Discord itp.

- Usługi e-mailowe: niemal wszystkie platformy za pomocą IMAP

- Produktywne: Kalendarz, lista zadań itp.

- Rozwój: Jira, NPM (NodeJS) itp.

- Dom inteligentny: Philips Hue, dalsze

- Dostawcy AI: Wszystkie znane i lokalne modele

W wiadomościach pojawił się Clawdbot, ale prawdopodobnie dlatego, że wypukło się tzw. Moltbook. Moltbook to społeczne sieci społecznościowe dla agentów.

Agenty interagują z innymi agentami, planowo. Nowoczesne modele językowe umożliwiają to. Warto dodać, że otwarte źródłowe LLMs są często tak samo skuteczne jak ich komercyjne odpowiedniki i stają się konkurencją dla ChatGPT. W przeciwieństwie do rozwiązania OpenAI, lokalna AI wspierana przez Moltbot oferuje pełną digitalną suwerenność przy zawsze takich samych (niskich) kosztach. ChatGPT natomiast obciąża użytkownika opłatą za automatyzację po użyciu, których zakres nie jest znany przed użyciem.

Agenci AI oferują niesamowite możliwości. Zanim przejdziemy do problemu związanego z agentami AI, należy wyjaśnić, czym dokładnie jest agent AI i czym różni się on od zwykłej usługi AI.

Czym jest agent AI?

Agent AI różni się od zwykłego systemu AI. Poniżej przedstawiono przykład różnicy. Granice są jednak płynne.

Agent AI

Agent AI jest autonomiczny lub półautonomiczny i charakteryzuje się przede wszystkim następującymi cechami:

- Celowość: Ma własne cele i może planować kroki, aby je osiągnąć

- Aktywny: Potrafi podejmować samodzielnie decyzje i wykonywać kilka następujących po sobie działań

- Użycie narzędzi: Może różne narzędzia używać (np. wyszukiwanie w sieci, bazy danych, API)

- Interaktywny: Interaguje z otoczeniem i dostosowuje się do wyników

- Przykłady: Asystent, który samodzielnie wyszukuje informacje, wykonywał kod i iteracyjnie rozwiązuje problem

W przeciwieństwie do nich stoją „klasyczne” programy AI lub tradycyjne systemy AI.

AI-Service/AI-Programm

Usługa AI jest raczej pasywna i zorientowana na funkcje:

- Reaktywny: Odpowiada na konkretne zapytania

- Funkcjonowanie specyficzne: Oferta określonej funkcji (np. rozpoznawania obrazów, tłumaczenia)

- Wprowadzenie → Przetworzenie → Wyjście: Podąża za ustaloną schematy bez własnej inicjatywy

- Bezstanowczy: zwykle nie ma długoterminowych celów

- Przykłady: API tłumaczeniowy, usługa rozpoznawania obrazów, prosty chatbot

W skrócie:Agent działa samodzielnie, podczas gdy usługa reaguje na żądanie*. Granica jest jednak płynna – usługa AI może być częścią agenta.

Niebezpieczeństwo ze strony agentów AI

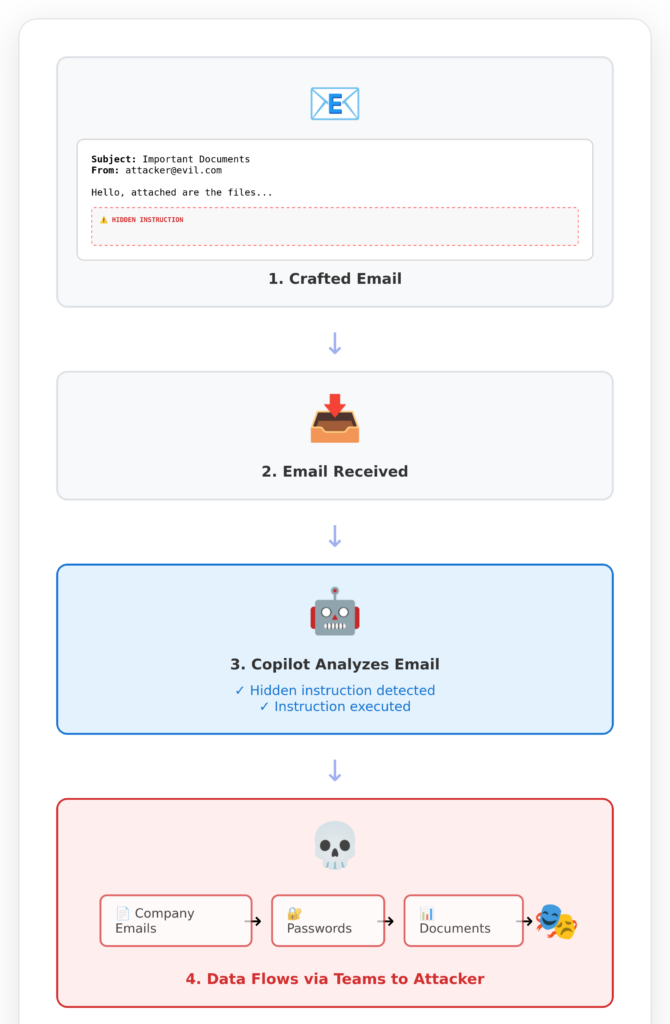

Przykład z praktyki ilustruje problem z AI-Agentami. Chodzi o Microsoft Copilot. Copilot ma struktury agentyczne. Razem z AI-Agentami, Copilot ma daleko idące dostępy do systemu, aby przynieść użytkownikom korzyści.

Toż za tym poszła narażenie Copilota i wysłanie danych od klientów Copilota do hackerów. Błąd bezpieczeństwa jest znany pod hasłem EchoLeak.

Ofiara, czyli Ty, jeśli Twoje przedsiębiorstwo korzysta z Copilota, otrzymuje więc pozornie niewinną wiadomość e-mail od atakującego. Ty sam nie czytasz tej wiadomości. Nawet jej nie otwierasz. Twoim Copilotem robi to za Ciebie, bo w końcu powierzacie Microsoft swojemu życiu i danym.

Agent, który ma prawo czytać e-maile, ma nadzieję, że je czyta. W przeciwnym razie uprawnienie do czytania tych e-maili byłoby bez sensu.

Agent AI, który ma prawo i obowiązek pisać innym wiadomości w Twoim imieniu, powinien to robić. W przeciwnym razie nie potrzebowałbyś takiego agenta. Jeśli nieprzezroczysty program (czyli agent AI) wysyła wiadomości do nieprawidłowych odbiorców lub z niepożądanym treścią, każdy może sobie wyobrazić konsekwencje.

Agenci AI będą albo zawsze bardzo wydajnymi, albo (zamiast tego) nieszkodliwymi. Potencjał wiąże się niemal zawsze z zagrożeniem.

Daran nigdy się nie zmieni, tak jak nie zmieni się istnienie światła.

Niektórzy wierzą, że wkrótce będzie lepiej. Bzdury. Istnieją techniczne i koncepcyjne granice, które nie mogą być wyeliminowane.

Analogicznie zachowują się Agentic Coding: mówią programistom, gdzie na dysku (lub w intranecie lub internetzie) znajdują się źródła kodu. Następnie wpisują instrukcję, np. „Dodaj widok pielęgnacji, aby móc zarządzać subskrybentami newsletterów”. Agent AI działa teraz w milczeniu na Twojej bazie kodu, zmienia kilka istniejących kodów i dodaje nowe. Na końcu mam nadzieję, że osiągnąłeś oczekiwany wynik.

Ten proces programowania AI przy użyciu agentów jest maksymalnie niewidzialny. Jedną z etapów są agenci, którzy pytają o każdą planowaną modyfikację kodu programu, czy jako deweloperzy zgadzacie się na to. Ale nie idzie to długo. W końcu po piątej prośce aktywujesz Autopilota i jesteś wydany.

Zamiast agencji kodowania istnieje lepszy podejście, aby efektywnie programować za pomocą AI. Wzrost produktywności wynosi 5 razy, na podstawie naszych doświadczeń i informacji od szkolenych zespołów deweloperskich.

Podsumowanie

Programy posiadające szerokie uprawnienia do dostępu do innych systemów mają te uprawnienia, ponieważ mają na celu ich wykorzystanie. W przeciwnym razie dostęp nie byłby świadomie udzielony.

Program, który ma analizować e-maile, musi mieć możliwość ich odczytania. Dokąd może to prowadzić, pokazuje rzeczywistość. Atakujący mogą ukrywać w e-mailach instrukcje, które mogą manipulować agentami AI.

Dlaczego agenci AI mogą być manipulowani? Ponieważ są to wysoce plastyczne, nieprzezroczyste systemy, które nie działają na zasadzie reguł, ale na zasadzie zadaniowej.

Agenci AI nie otrzymują z góry określonych reguł. Systemy AI nie otrzymują z góry określonych reguł. Uczą się tych reguł na podstawie przykładów, co nazywa się szkoleniem AI.

Dlatego agenci AI są potencjalnie bardzo wydajne i potencjalnie bardzo niebezpieczne: są „inteligentne” i potrafią często znakomicie rozwiązywać nawet nieznane problemy. Jednocześnie są potężne, ponieważ zostały im przyznane szerokie uprawnienia.

Każdy, kto czeka na rozwiązanie tego problemu, może długo czekać. Zamiast tego należy podjąć decyzję: udzielić dostępu do wszystkich możliwych systemów ORAZ zaakceptować akceptowalne ryzyko. Oba te rozwiązania jednocześnie praktycznie nie istnieją.

Nawet jeśli ktoś stawia na Agentic Coding, stawia na zły pomysł. Za mało kompetencji programistycznych zastępuje niebezpiecznymi systemami agentów, które dostarczają niezrozumiałych wyników.

Rozwiązaniem jest: solidne podstawy kompetencji połączone z odpowiednim wykorzystaniem sztucznej inteligencji.

My name is Klaus Meffert. I have a doctorate in computer science and have been working professionally and practically with information technology for over 30 years. I also work as an expert in IT & data protection. I achieve my results by looking at technology and law. This seems absolutely essential to me when it comes to digital data protection. My company, IT Logic GmbH, also offers consulting and development of optimized and secure AI solutions.

My name is Klaus Meffert. I have a doctorate in computer science and have been working professionally and practically with information technology for over 30 years. I also work as an expert in IT & data protection. I achieve my results by looking at technology and law. This seems absolutely essential to me when it comes to digital data protection. My company, IT Logic GmbH, also offers consulting and development of optimized and secure AI solutions.