Como término de moda, los agentes de IA están en boca de todos. Con el Moltbot (Clawdbot) se convirtieron en populares definitivamente. Sin embargo, los agentes de IA necesitan amplias autorizaciones para poder funcionar de manera efectiva. Esto conlleva un gran peligro que emana de esos programas autónomos e intransapentes.

Introducción

Los correos electrónicos con solicitudes estándar que llegan a su bandeja de entrada se responderán automáticamente, sin que tenga que intervenir. Escribe una tarea de investigación en su mensajero Signal. Su agente de IA asume la tarea, busca la información necesaria en los motores de búsqueda y crea una respuesta que puede leer un minuto después en el mensajero o abrir a través de un enlace a un informe desde allí.

Exactamente lo mismo y mucho más es posible con agentes de inteligencia artificial. Incluso hay una solución de código abierto que logra esto. Se llama Clawdbot (anteriormente Clawdbot) y se ha vuelto muy popular en un breve período de tiempo. El desarrollador de Moltbot logró lo que las gigantes del Big Tech no habían podido hacer con sus presupuestos millonarios.

Moltbot ofrece la posibilidad de vincular frecuentemente utilizados canales y servicios, entre otros.

- Mensajería: Signal, Discord, etc.

- Servicios de correo electrónico: sobre IMAP casi todas las plataformas

- Productividad: Calendario, listas de tareas, etc.

- Desarrollo: Jira, NPM (NodeJS) etc.

- Casa Inteligente: Philips Hue, otros

- Proveedores de Inteligencia Artificial: Todos los modelos conocidos y locales

En las noticias salió a relucir el Moltbot, pero probablemente fue debido al llamado Moltbook. El Moltbook es un red social para agentes.

Los agentes interactúan con otros agentes de manera planificada. Los modelos de lenguaje modernos lo hacen posible. Por cierto, los LLMs de código abierto son a menudo tan eficaces como sus competidores comerciales y así le hacen competencia a ChatGPT. A diferencia de la solución de OpenAI, la inteligencia artificial local, que también es apoyada por Moltbot, ofrece una soberanía digital total con costos siempre iguales (bajos) y constantes. ChatGPT, por otro lado, factura por uso automático a través de la API después del uso, aunque el alcance del uso no se conoce antes de usarlo.

Los agentes de IA ofrecen asombrosas posibilidades. Antes de abordar el problema de los agentes de IA, se debe aclarar qué es exactamente un agente de IA y cómo se diferencia de un servicio de IA común.

¿Qué es un agente de IA?

Un agente de IA se diferencia de un sistema de IA común. Lo siguiente ilustra la diferencia. Sin embargo, los límites son fluidos.

Agente de IA

Un agente de IA es autónomo o semiautónomo y se caracteriza especialmente por los siguientes rasgos:

- Objetivo orientado: Tiene sus propios objetivos y puede planificar pasos para lograrlos

- Capaz de actuar: Puede tomar decisiones por sí mismo y realizar varias acciones consecutivas

- Uso de herramientas: Puede utilizar varias herramientas (por ejemplo, búsqueda en la web, bases de datos, APIs)

- Interactivo: Interactúa con su entorno y se adapta a los resultados

- Ejemplos: Un asistente que investiga de manera independiente, ejecuta código y resuelve iterativamente un problema

En contraste con esto se encuentran los "programas de IA clásicos" o los sistemas de IA tradicionales.

AI-Service/AI-Programm

Un servicio de IA es más pasivo y orientado a funciones:

- Reactiva: Responde a solicitudes específicas

- Específicamente funcional: Ofrece una función específica (por ejemplo, reconocimiento de imágenes, traducción)

- Entrada → Procesamiento → Salida: Sigue un patrón fijo sin iniciativa propia

- Sin estado: suele no mantener metas a largo plazo

- Ejemplos: Una API de traducción, un servicio de reconocimiento de imágenes, un simple chatbot

En resumen: Un agente actúa de manera independiente, mientras que un servicio reacciona a petición. La frontera es fluida – un servicio de IA puede ser parte de un agente.

Peligro por agentes de IA

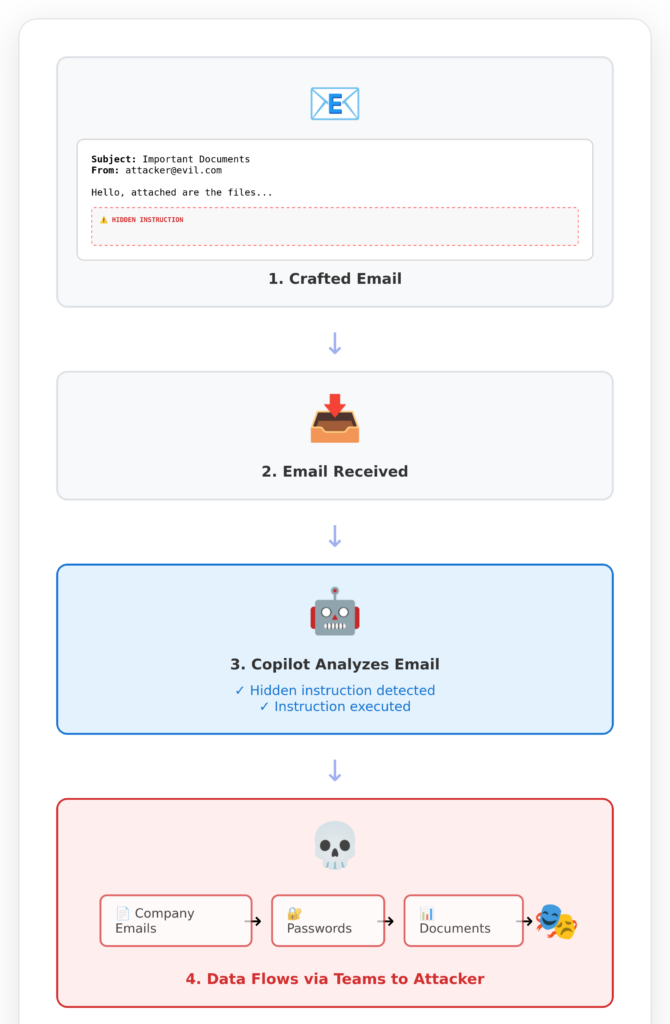

Un ejemplo de la práctica ilustra el problema con los agentes AI. Se trata del Microsoft Copilot. Copilot tiene estructuras agenciales. Con los agentes AI, Copilot tiene, al menos, que realizar accesos sistemáticos amplios para poder ser beneficioso para los usuarios.

Esto llevó a que Copilot fuera vulnerable y enviara datos de clientes de Copilot a hackers. La vulnerabilidad es conocida bajo el epígrafe EchoLeak.

La víctima, es decir, usted, si su empresa utiliza Copilot, recibirá un correo electrónico aparentemente inofensivo de un atacante. Usted mismo no leerá ese correo electrónico ni siquiera lo abrirá. Su Copilot lo hará por usted, porque al fin y al cabo, confía en Microsoft su vida y sus datos.

Un agente que tiene permiso para leer correos electrónicos, con suerte, también los leerá. De lo contrario, el permiso para leer sus correos electrónicos sería absurdo.

Un agente de IA que tiene permiso para escribir mensajes a otros en su nombre, con la esperanza de que lo haga. De lo contrario, no necesitaría ese agente. Si un programa intransparentes (un agente de IA) envía mensajes a los destinatarios equivocados o con contenido no deseado, cualquiera puede imaginar las consecuencias.

Los agentes de IA serán siempre ya muy potentes o (en cambio) inofensivos. La capacidad conlleva casi siempre peligro.

Eso nunca cambiará, al igual que la existencia de la luz.

Algunos creen que pronto todo será mejor. Mentira. Hay límites técnicos y conceptuales que no se pueden eliminar.

Análogamente se comporta con Agentic Coding: le dicen al programador de inteligencia artificial, dónde están ubicados los archivos de código (o en el intranet o internet) y luego teclean una instrucción, como "agregue una vista de mantenimiento para poder gestionar a los suscriptores de boletines". El agente de IA trabaja ahora en silencio sobre su base de código, modifica un par de códigos existentes y agrega nuevos. Al final, esperan tener el resultado deseado.

Este proceso de programación de IA mediante agentes es maximalmente intransparente. Una etapa intermedia son los agentes que, cada vez que planean modificar su código del programa, preguntan si como desarrollador estás de acuerdo. Pero eso no dura mucho tiempo. Al menos después de la quinta solicitud activarás el Autopiloto y estarás entregado.

En lugar de codificación agente, existe un mejor enfoque para programar eficientemente con IA. La mejora de la productividad es de un factor 5, según nuestras experiencias y las retroalimentaciones de los equipos de desarrollo capacitados.

Conclusión

Los programas que tienen amplios accesos a otros sistemas los tienen porque están diseñados para ser utilizados. De lo contrario, el acceso no se concedería conscientemente.

Un programa diseñado para analizar correos electrónicos debe, y debería, poder leerlos. La realidad demuestra a dónde puede llevar esto por sí solo. Los atacantes pueden incluir instrucciones en los correos electrónicos que puedan manipular a los agentes de IA.

¿Por qué pueden manipularse a los agentes de IA? Porque se trata de sistemas altamente plásticos e intransparentes que no funcionan de forma regla-basada, sino tarea-basada.

Los agentes de IA no reciben reglas preestablecidas. Los sistemas de IA no reciben reglas preestablecidas. Aprende estas reglas a partir de ejemplos por sí mismos. Esto se conoce como entrenamiento de IA.

Por lo tanto, los agentes de IA son potencialmente muy potentes y potencialmente muy peligrosos: son "inteligentes" y también pueden resolver con frecuencia de manera excelente problemas desconocidos. Al mismo tiempo, son poderosos porque se les han otorgado amplias autorizaciones.

Quien espere una solución a este problema, esperará mucho tiempo. En cambio, hay que decidir: conceder acceso a todos los sistemas posibles O bien aceptar un riesgo aceptable. No existe la posibilidad de tener ambos a la vez.

Incluso quienes apuestan por el código agentico, apuestan por el camino equivocado. Se sustituye la insuficiente competencia de programación por sistemas de agentes peligrosos que generan resultados no explicables.

La solución es: un sólido fundamento de competencia combinado con el uso adecuado de la IA.

Me llamo Klaus Meffert. Soy doctor en informática y llevo más de 30 años dedicándome profesional y prácticamente a las tecnologías de la información. También trabajo como experto en informática y protección de datos. Obtengo mis resultados analizando la tecnología y el Derecho. Esto me parece absolutamente esencial cuando se trata de protección de datos digitales.

Me llamo Klaus Meffert. Soy doctor en informática y llevo más de 30 años dedicándome profesional y prácticamente a las tecnologías de la información. También trabajo como experto en informática y protección de datos. Obtengo mis resultados analizando la tecnología y el Derecho. Esto me parece absolutamente esencial cuando se trata de protección de datos digitales.