Als Buzz-Word sind KI-Agenten in aller Munde. Mit dem Moltbot (Clawdbot) wurden die künstlichen Agenten dann endgültig populär. Jedoch benötigen KI-Agenten weitreichende Berechtigungen, um effektiv arbeiten zu können. Das bedingt eine große Gefahr, die von solchen autonomen und intransparenten Programmen ausgeht.

Einleitung

Die E-Mails mit Standardanfragen, die in Ihrem Posteingang eintrudeln, werden automatisch beantwortet, ohne dass Sie eingreifen müssen. Sie schreiben eine Rechercheaufgabe in Ihren Signal-Messenger. Ihr KI-Agent übernimmt die Aufgabe, sucht die benötigten Informationen in Suchmaschinen zusammen und erstellt eine Antwort, die Sie eine Minute später im Messenger lesen oder per Link auf einen Bericht von dort öffnen können.

Genau dies und noch viel mehr ist mit KI-Agenten möglich. Es gibt sogar eine Open-Source Lösung, die das leistet. Sie heißt OpenCloaw (zuvor Moltbot oder Clawdbot) und wurde innerhalb kürzester Zeit bekannt. Der Entwickler von OpenClaw schaffte das, was milliardenschwere Big Tech Konzerne zuvor nicht auf die Reihe bekamen.

OpenClaw bietet die Möglichkeit, häufig genutzte Kanäle und Dienste anzubinden, u. a.

- Messenging: Signal, Discord usw.

- E-Mail-Dienste: über IMAP quasi alle Plattformen

- Produktivität: Kalender, To-do-Listen, usw.

- Entwicklung: Jira, NPM (NodeJS) usw.

- Smart Home: Philips Hue, weitere

- KI-Anbieter: Alle bekannten und lokale Modelle

In die Nachrichten kam OpenClaw aber wohl wegen des sogenannten Moltbook. Moltbook ist ein Soziales Netzwerk für Agenten.

Agenten interagieren also mit anderen Agenten, und zwar planmäßig. Moderne Sprachmodelle machen es möglich. Übrigens sind Open-Source LLMs oft ähnlich leistungsfähig wie die kommerziellen Platzhirsche und machen so ChatGPT Konkurrenz. Im Gegensatz zu OpenAI's Lösung bietet lokale KI, die auch von Moltbot unterstützt wird, eine völlige digitale Souveränität bei immer gleich bleibenden (niedrigen) Kosten. ChatGPT hingegen rechnet bei automatisierter Nutzung über die API nach Nutzungsumfang ab, der allerdings vor Nutzung nicht bekannt ist.

KI-Agenten bieten erstaunliche Möglichkeiten. Bevor auf die Problematik mit KI-Agenten eingegangen wird, soll geklärt werden, was ein KI-Agent überhaupt ist und was ihn von einem ordinären KI-Dienst unterscheidet.

Was ist ein KI-Agent?

Ein KI-Agent unterscheidet sich von einem gewöhnlichen KI-System. Die folgende Gegenüberstellung veranschaulicht den Unterschied. Die Grenzen sind allerdings fließend.

KI-Agent

Ein KI-Agent ist autonom oder semi-autonom und zeichnet sich insbesondere durch folgende Merkmale aus:

- Zielorientiert: Hat eigene Ziele und kann Schritte planen, um diese zu erreichen

- Handlungsfähig: Kann eigenständig Entscheidungen treffen und mehrere aufeinanderfolgende Aktionen ausführen

- Werkzeugnutzung: Kann verschiedene Tools verwenden (z. B. Websuche, Datenbanken, APIs)

- Interaktiv: Interagiert mit seiner Umgebung und passt sich an Ergebnisse an

- Beispiel: Ein Assistent, der selbstständig recherchiert, Code ausführt und in mehreren Durchläufen ein Problem löst

Im Gegensatz dazu stehen „klassische“ KI-Programme oder herkömmliche KI-Systeme.

KI-Service/KI-Programm

Ein KI-Service ist eher passiv und funktionsorientiert:

- Reaktiv: Reagiert auf spezifische Anfragen

- Funktionsspezifisch: Bietet eine bestimmte Funktion (z. B. Bilderkennung, Übersetzung)

- Eingabe → Verarbeitung → Ausgabe: Folgt einem festen Muster ohne eigene Initiative

- Zustandslos: behält typischerweise keine langfristigen Ziele

- Beispiele: Eine Übersetzungs-API, ein Bilderkennungs-Service, ein einfacher Chatbot

Kurz gesagt: Ein Agent handelt eigenständig, während ein Service auf Anfrage reagiert. Die Grenze ist aber fließend – ein KI-Service kann Bestandteil eines Agenten sein.

Gefahr durch KI-Agenten

Ein Beispiel aus der Praxis verdeutlicht das Problem mit KI-Agenten. Es geht um Microsoft Copilot. Copilot hat agentische Strukturen. Mit KI-Agenten gemeinsam hat Copilot jedenfalls, dass es weit reichende Systemzugriffe hat, um den Nutzern Nutzen bringen zu können.

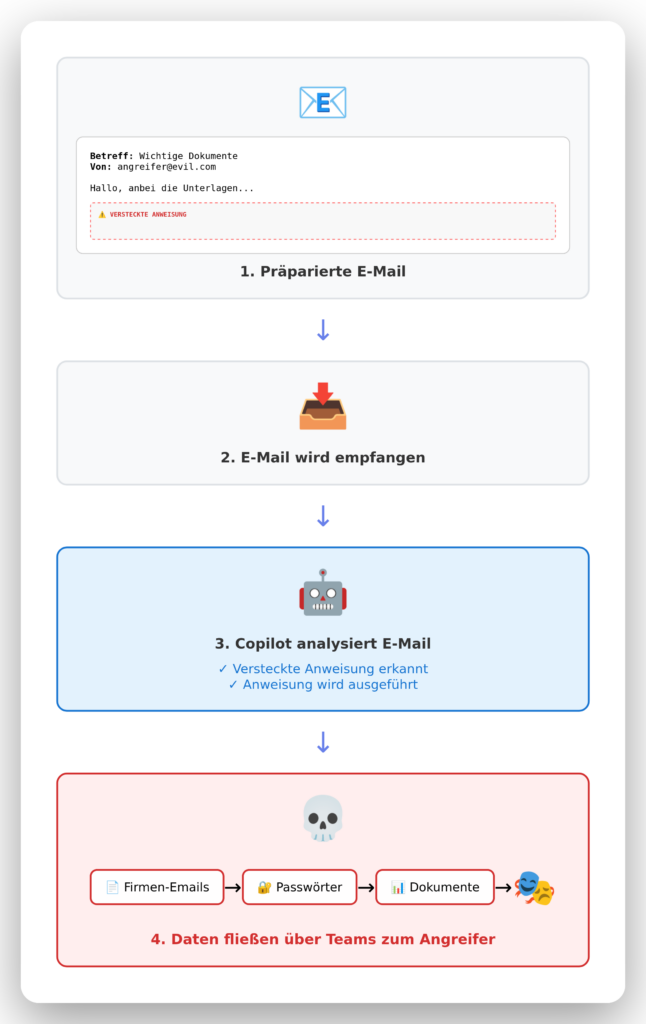

Dies führte dazu, dass Copilot angreifbar wurde und Daten von Copilot-Kunden an Hacker sendete. Die Sicherheitslücke ist unter dem Schlagwort EchoLeak bekannt.

Das Opfer, also Sie, wenn Ihr Unternehmen Copilot nutzt, bekommt also eine harmlos wirkende E-Mail von einem Angreifer. Sie selbst lesen diese Mail nicht. Sie öffnen diese Mail nicht einmal. Das tut Ihr Copilot für Sie, denn schließlich vertrauen Sie Microsoft Ihr Leben und Ihre Daten an.

Ein Agent, der E-Mails lesen darf, liest diese E-Mails hoffentlich auch. Denn ansonsten wäre die Berechtigung zum Lesen Ihrer E-Mails unsinnig.

Ein KI-Agent, der anderen eine Nachricht in Ihrem Namen schreiben darf und soll, tut dies hoffentlich auch. Denn ansonsten bräuchten Sie diesen Agenten gar nicht. Wenn ein intransparentes Programm (= KI-Agent) nun Nachrichten an die falschen Empfänger oder mit unerwünschtem Inhalt sendet, kann sich jeder selbst die Folgen ausmalen.

KI-Agenten werden immer entweder sehr leistungsfähig oder (stattdessen) harmlos sein können.

Daran wird sich nie etwas ändern, genau wie an der Existenz von Licht.

Leistungsfähigkeit schließt Gefährlichkeit quasi immer mit ein.

Manche glauben, demnächst wird alles besser. Bullshit. Es gibt technische und konzeptionelle Grenzen, die nicht eliminiert werden können.

Analog verhält es sich mit Agentic Coding: Sie sagen dem KI-Programmierknecht, wo auf der Festplatte (oder im Intranet oder Internet) Ihre Quelltexte liegen. Dann tippen Sie eine Anweisung ein, etwa „Füge eine Pflege-View hinzu, um Newsletter-Abonnenten verwalten zu können.“ Der KI-Agent arbeitet nun still und leise auf Ihrer Code-Basis, verändert ein paar bestehende Codes und fügt neue hinzu. Am Ende haben Sie hoffentlich das gewünschte Ergebnis.

Dieser Prozess der KI-Programmierung mithilfe von Agenten ist maximal intransparent. Eine Zwischenstufe sind Agenten, die bei jeder geplanten Modifikation Ihres Programmcodes nachfragen, ob Sie als Entwickler damit einverstanden sind. Das geht aber nicht lange gut. Spätestens nach der fünften Nachfrage werden Sie den Autopiloten aktivieren und sind ausgeliefert.

Statt Agentic Coding gibt es einen besseren Ansatz, um hocheffizient mit KI zu programmieren. Die Produktivitätssteigerung liegt bei Faktor 5, nach unseren Erfahrungen und den Rückmeldungen der geschulten Entwicklerteams.

Fazit

Programme, die weit reichende Zugriffe auf andere Systeme haben, haben diese Zugriffe, weil sie genutzt werden sollen. Andernfalls würde der Zugriff wissentlich nicht gewährt werden.

Ein Programm, das E-Mails auswerten soll, muss und soll diese E-Mails lesen können. Wohin das alleine führen kann, zeigt die Realität. Angreifer können Anweisungen in E-Mails hinterlegen, die KI-Agenten manipulieren können.

Warum können KI-Agenten manipuliert werden? Weil es sich um hochplastische, intransparente Systeme handelt, die nicht Regel-basiert, sondern Aufgaben-basiert arbeiten.

KI-Agenten bekommen keine Regeln vorgegeben. KI-Systeme bekommen keine Regeln vorgegeben. Sie lernen diese Regeln anhand von Beispielen selbst. Das wird als KI-Training bezeichnet.

Deshalb sind KI-Agenten potentiell sehr leistungsfähig und potentiell sehr gefährlich: Sie sind „intelligent“ und können auch unbekannte Problemstellungen oft hervorragend lösen. Zugleich sind sie mächtig, weil ihnen umfassende Berechtigungen erteilt wurden.

Jeder, der auf eine Änderung dieses Problems wartet, kann lange warten. Stattdessen sollte man sich entscheiden: Zugriff auf alle möglichen Systeme erteilen ODER ein akzeptables Risiko. Beides gleichzeitig gibt es praktisch nicht.

Auch wer auf Agentic Coding setzt, setzt auf den falschen Zug. Zu wenig Programmier-Kompetenz wird durch gefährliche Agentensysteme, die nicht nachvollziehbare Ergebnisse liefern, ersetzt.

Die Lösung ist: Ein solides Fundament an Kompetenz gepaart mit der angemessenen Nutzung von KI.

KI-Beratung, KI-Lösungen

Leistungsangebot:

- Erstberatung inkl. Machbarkeitsaussagen

- Schulungen und Workshops für Führungskräfte, Berufsgeheimnisträger, Angestellte, Entwickler

- KI-Lösungen mit und ohne ChatGPT/Azure. Cloud oder eigener KI-Server

gekennzeichnet.

gekennzeichnet.

Mein Name ist Klaus Meffert. Ich bin promovierter Informatiker und beschäftige mich seit über 30 Jahren professionell und praxisbezogen mit Informationstechnologie. In IT & Datenschutz bin ich auch als Sachverständiger tätig. Ich stehe für pragmatische Lösungen mit Mehrwert. Meine Firma, die

Mein Name ist Klaus Meffert. Ich bin promovierter Informatiker und beschäftige mich seit über 30 Jahren professionell und praxisbezogen mit Informationstechnologie. In IT & Datenschutz bin ich auch als Sachverständiger tätig. Ich stehe für pragmatische Lösungen mit Mehrwert. Meine Firma, die