Viele Unternehmen setzen große Hoffnungen in Microsoft Copilot – und verschwenden so Zeit oder erlauben Dateneinsichten oder zahlen gar Lizenzgebühren. Doch ein genauer Blick in Microsofts eigene Nutzungsbedingungen offenbart eine verblüffende Wahrheit: Der Konzern selbst schließt jeden ernsthaften Unternehmenseinsatz seines KI-Assistenten aus.

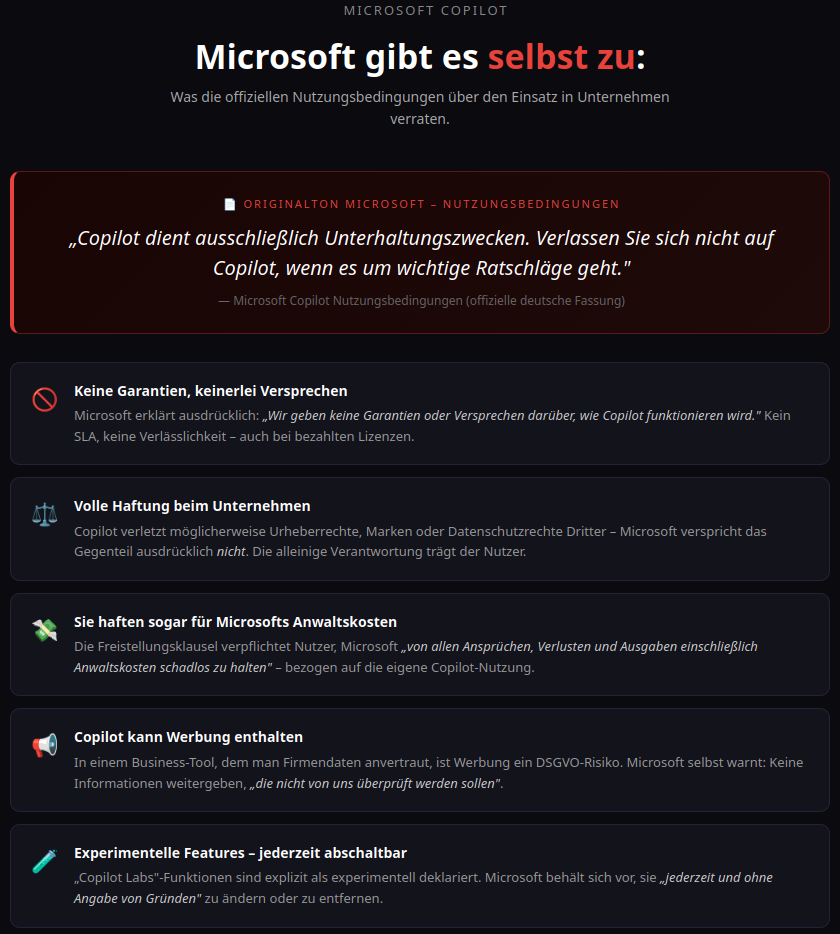

„Nur zur Unterhaltung“ – Microsofts eigene Worte

In den offiziellen Nutzungsbedingungen für Microsoft Copilot findet sich ein Satz, der aufhorchen lässt:

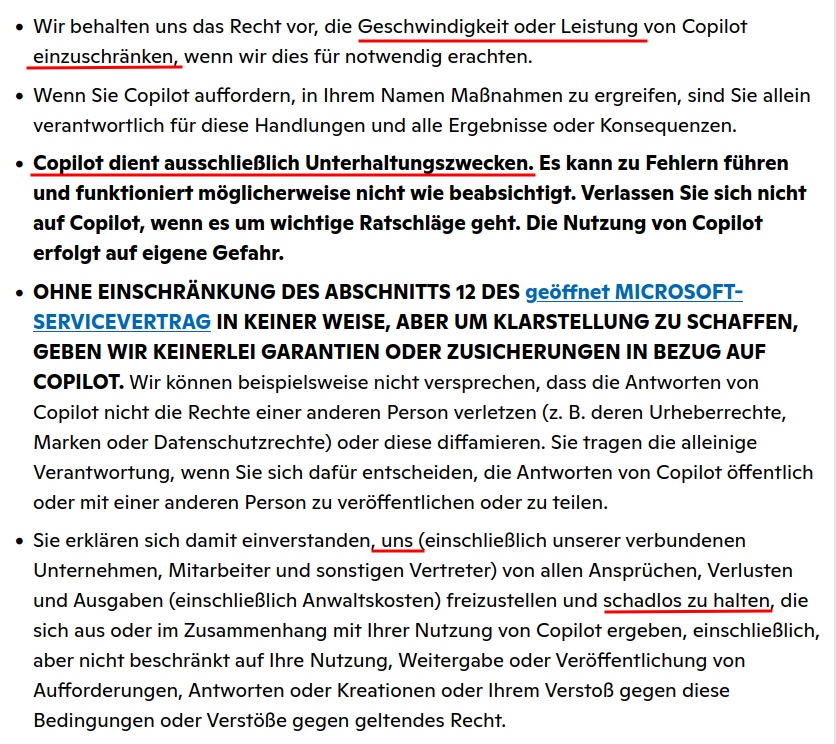

„Copilot dient ausschließlich Unterhaltungszwecken.“

Das ist keine Fußnote im Kleingedruckten – das ist Microsofts offizielle Rechtsposition. Ein Tool, das Unternehmen für das Verfassen von E-Mails, die Code-Generierung, die Analyse von Dokumenten oder die Automatisierung von Geschäftsprozessen einsetzen sollen, ist laut seinem eigenen Hersteller nur zur Unterhaltung gedacht.

Die vorliegenden Nutzungsbedingungen gelten ausschließlich für den Microsoft Copilot im Privatkundenbereich oder für eigenständige Copilot-Apps oder für Copilot im Web oder für X (siehe Nutzungsbedingungen). Für den kommerziellen Microsoft 365 Copilot gilt ein separates Vertragswerk – bestehend aus Microsoft Product Terms, Data Protection Addendum und Enterprise Agreement. Dort wird zur Qualität der Ergebnisse keine Aussage getroffen.

Es stellt sich die Frage, ob es zwei qualitativ relevant verschiedene Copilot-KI-Modelle gibt. Dies wird wohl nicht der Fall sein. Copilot 1 ist laut Microsoft nur zu Unterhaltungszwecken geeignet und für Copilot 2 wurde dazu von Microsoft nichts mitgeteilt. Copilot 2 scheint aber auf der gleichen KI zu basieren wie das Entertainment-Copilot. „Werfen mit Papier“ zur Verschleierung von Unzulänglichkeiten könnte man es auch nennen. Immerhin wird Copilot Chat als „Ihr verlässlicher KI-Chat für die Arbeit“ beworben (Quelle). Für Unternehmen wird die Standard-Datensicherheit zugesichert wie für Produkte im Unternehmenskontext. Das bedeutet: Formal soll die DSGVO eingehalten werden. Real können US-Behörden und US-Geheimdienste die DSGVO jederzeit umgehen und sich dazu Microsofts Mitarbeit bedienen, um Deutsche auszuspionieren.

Microsoft gibt auch im Unternehmenskontext an drei verschiedenen Stellen (Copilot FAQ, KI-Haftungsausschlüsse, Copilot Connectors) klar zu verstehen, dass Copilot-Antworten fehlerhaft, ungenau oder veraltet sein können – nur eben ohne das plakativer formulierte „nur für Unterhaltungszwecke" aus den Individualbedingungen. Der Unterschied ist eher rhetorischer Natur: sachlicher, juristischer Ton statt des deutlichen Verbraucherwarnhinweises – der Kern der Aussage ist jedoch analog.

Damit stellt sich für jedes Unternehmen, das Copilot im professionellen Kontext nutzt, eine ernste Frage: Auf welcher Grundlage tut ein Unternehmen das eigentlich?

Keine Garantien. Keine Zusicherungen. Keine Verlässlichkeit.

Microsoft ist in seinen Nutzungsbedingungen bemerkenswert offen – fast schon ehrlich bis zur Selbstdemontage. Die wichtigsten Punkte im Überblick:

❌ Keinerlei Garantien

Microsoft erklärt in aller Deutlichkeit:

„Wir geben keine Garantien oder Versprechen darüber, wie Copilot funktionieren wird oder dass es wie beabsichtigt funktioniert.“

Für ein Unternehmensprodukt, das Copilot aggressiv vermarktet hat, ist das eine außergewöhnliche Aussage. Kein SLA, keine Funktionsgarantie, keine Verlässlichkeitszusage.

❌ Keine Haftung bei Rechtsverletzungen

Microsoft schreibt explizit:

„Wir können beispielsweise nicht versprechen, dass die Antworten von Copilot nicht die Rechte einer anderen Person verletzen (z. B. deren Urheberrechte, Marken oder Datenschutzrechte) …“

Wer also Copilot-generierte Texte, Bilder oder Code in seinem Unternehmen verwendet und damit Urheberrechte Dritter verletzt, steht allein da – Microsoft übernimmt keinerlei Haftung. Das klang mal anders, als Microsoft noch versprach, für Urheberrechtsprobleme von Kunden und Nutzern den Kopf hinzuhalten.

❌ Volle Haftung liegt beim Nutzer

Noch deutlicher wird Microsoft bei Aktionen, die Copilot im Auftrag des Nutzers ausführt:

„Wenn Sie Copilot auffordern, in Ihrem Namen Maßnahmen zu ergreifen, sind Sie allein verantwortlich für diese Handlungen und alle Ergebnisse oder Konsequenzen.“

Das bedeutet im Klartext: Automatisierte Prozesse, ausgelöst durch Copilot? Volle Verantwortung beim Unternehmen. Microsoft bereitet sich auf das Zeitalter der Agenten vor. Wer sichere Lösungen braucht, sollte keine Agenten einsetzen. KI und Agenten sind erst einmal zwei völlig verschiedene Welten.

❌ Schadloshaltung – Sie haften für Microsoft

Besonders brisant ist die Freistellungsklausel. Unternehmen stimmen zu:

„[…] uns […] von allen Ansprüchen, Verlusten und Ausgaben (einschließlich Anwaltskosten) freizustellen und schadlos zu halten, die sich aus oder im Zusammenhang mit Ihrer Nutzung von Copilot ergeben …“

Das heißt: Nicht nur haftet Microsoft nicht – im Zweifelsfall müssen Sie für Microsofts Rechtskosten aufkommen, wenn es wegen Ihrer Copilot-Nutzung zu Klagen kommt. Zum Glück sind deutsche Aufsichtsbehörden nicht dafür bekannt, gegen Microsoft vorzugehen. Aber vielleicht tut es ja ein Privatunternehmen oder die amerikanische Regierung (siehe Anthropic, die es sich mit der US-Administration verscherzt hatten, weil sie einer Bitte nicht nachkamen).

Werbung inklusive – das sollte jeder Datenschutzbeauftragte wissen

Ein weiterer Punkt, der in Unternehmensumgebungen alarmieren sollte: Copilot kann Werbung enthalten. So steht es in den oben genannten Nutzungsbedingungen.

Wer schützenswerte Geschäftsdaten, Kundendaten oder interne Dokumente in ein System eingibt, das Werbung schaltet und bei dem Microsoft ausdrücklich erklärt, man solle keine Informationen weitergeben, die nicht von Microsoft überprüft werden sollen – der handelt möglicherweise fahrlässig im Sinne der DSGVO. Siehe etwa Artikel 5 DSGVO (Richtigkeit von Daten etc.) oder Artikel 6 DSGVO (Rechtsgrundlagen der Datenverarbeitung).

„Copilot Labs“ – experimentell und ohne Versprechen

Bestimmte Funktionen laufen unter dem Label „Copilot Labs“. Microsoft dazu:

„Diese Features und Dienste sind sehr experimentell und funktionieren möglicherweise nicht immer wie beabsichtigt. Wir behalten uns das Recht vor, jederzeit und ohne Angabe von Gründen Features oder Services von Copilot Labs hinzuzufügen, zu ändern oder zu entfernen.“

Wer Geschäftsprozesse auf experimentelle Features aufbaut, die jederzeit ohne Ankündigung verschwinden können, baut auf Sand.

Was bedeutet das für Unternehmen?

Die Konsequenzen aus diesen Nutzungsbedingungen sind klar:

- Rechtliches Risiko: Copilot-generierte Inhalte können Urheberrechte verletzen – auf Kosten des Unternehmens.

- Compliance-Risiko: Ein Tool „nur zur Unterhaltung“ ist keine belastbare Grundlage für unternehmenskritische Prozesse.

- Datenschutz-Risiko: Werbeinhalte und fehlende Datenschutzgarantien sind problematisch im Lichte der DSGVO.

- Haftungsrisiko: Unternehmen haften für alle Handlungen, die Copilot in ihrem Namen ausführt – und stellen Microsoft im Streitfall sogar schadlos.

- Zuverlässigkeitsrisiko: Microsoft kann Copilot jederzeit drosseln, ändern oder Funktionen entfernen.

Fazit: Kein ernstes Werkzeug für den professionellen Einsatz

Es ist nicht Kritik von außen, die Copilot in Frage stellt – es sind Microsofts eigene Nutzungsbedingungen. Wer als Unternehmen Copilot professionell (und unter der Annahme, belastbare Ergebnisse zu erhalten) einsetzt, tut dies gegen den ausdrücklichen Willen und die rechtliche Positionierung des Herstellers.

Alle zitierten Aussagen stammen aus den offiziellen Microsoft Copilot-Nutzungsbedingungen. Das Beitragsbild zeigt einen Auszug aus den Microsoft Copilot Nutzungsbedingungen.

Der Rat an Unternehmen, Datenschutzbeauftragte und IT-Verantwortliche: Lesen Sie die Nutzungsbedingungen. Dann entscheiden Sie, ob ein Tool „ausschließlich zur Unterhaltung“ in Ihrer Unternehmensinfrastruktur etwas verloren hat.

Besser geht es mit souveräner KI, die mehrere positive Eigenschaften hat:

- Sicher: Daten sind und bleiben dort, wo sie hingehören: In Ihrem Unternehmen. Entweder auf Ihrer eigenen Hardware oder auf Miet-Hardware mit rein deutscher Beteiligung (Hosting, Wartung) und ohne Microsoft Azure. Bei Bedarf kann Ihre KI mit anderen Systemen kommunizieren oder Daten aus dem Internet abrufen – aber nur, wenn Sie das wollen!

- Optimierbar: Besser als ChatGPT! Das funktioniert immer dann, wenn Sie ungefähr wissen, was Sie mit Ihrer KI anstellen wollen. Aber selbst Unternehmens-Chatbots funktionieren oft besser und sind sicherer.

- Strategisch wertvoll: Planbare Fixkosten statt unsäglicher Token-Kosten, die niemand voraussagen kann. Ihr System mit planbarer Zukunft und Verlässlichkeit.

KI-Beratung, KI-Lösungen

Leistungsangebot:

- Erstberatung inkl. Machbarkeitsaussagen

- Schulungen und Workshops für Führungskräfte, Berufsgeheimnisträger, Angestellte, Entwickler

- KI-Lösungen mit und ohne ChatGPT/Azure. Cloud oder eigener KI-Server

gekennzeichnet.

gekennzeichnet.

Mein Name ist Klaus Meffert. Ich bin promovierter Informatiker und beschäftige mich seit über 30 Jahren professionell und praxisbezogen mit Informationstechnologie. In IT & Datenschutz bin ich auch als Sachverständiger tätig. Ich stehe für pragmatische Lösungen mit Mehrwert. Meine Firma, die

Mein Name ist Klaus Meffert. Ich bin promovierter Informatiker und beschäftige mich seit über 30 Jahren professionell und praxisbezogen mit Informationstechnologie. In IT & Datenschutz bin ich auch als Sachverständiger tätig. Ich stehe für pragmatische Lösungen mit Mehrwert. Meine Firma, die

Wie ist es im Unternehmenskontext zu werten, dass in diesen Nutzungsbedingungen auch Folgendes steht: "Diese Bedingungen gelten nicht für Microsoft 365 Copilot-Apps oder -Dienste, es sei denn, die jeweilige App oder der jeweilige Dienst besagt, dass diese Bedingungen gelten."

Vielen Dank!

In den für Unternehmen relevanten Microsoft-Dokumenten sind die Formulierungen andere. Es wird nichts zugesagt und an einigen Stellen (siehe Beitrag, dort sind 3 Stellen genannt) auf die Unzulänglichkeiten von Copilot und Copilot-Technologien verwiesen.

Wenn alleine das Vertragswerk schon so kompliziert ist, wie soll dann das Produkt besser sein?

Hallo Doktor

Herzlichen Dank für diese -bisher bei mir noch nicht aufgeploppte- Info. Hatte dazu gerade ein Gespräch mit einer Schule. Ihre Recherchen werden sehr hilfreich sein, dass zukünftig nicht jeder Hype was auf den Schul – oder Unternehmenscomputern zu suchen hat.

Willkommen bei der "Bild"-Zeitung .. – "Microsoft gibt es selbst zu"

Wie lachhaft ist bitte so eine Überschrift?

Dass man sich auf KI generierte Informationen nicht blind verlassen darf, ist nun wirklich nichts Neues. Genau deshalb enthalten praktisch alle KI Oberflächen entsprechende Warnhinweise. Wirklich neu ist daran nichts. Umso fragwürdiger ist es, daraus jetzt so ein großes Thema zu machen.

Ob KI nur für Unterhaltungszwecke gedacht ist oder ob es Warnhinweise gibt, dass KI generierte Antworten zu prüfen seien ("Warnhinweise"), sind schon zwei völlig verschiedene Perspektiven.

Ist es nicht erstaunlich, dass Microsoft die Unfähigkeit von Copilot selbst zugibt? Darf man das nicht auch in einer Überschrift ausbreiten?

Ein Text muss nicht jedem gefallen. Wir sind ein (halbwegs) freies Land.